¿Cómo funcionan los rastreadores web? Guía técnica completa

Aprende cómo funcionan los rastreadores web, desde las URLs semilla hasta la indexación. Comprende el proceso técnico, los tipos de rastreadores, las reglas de ...

Aprende qué es Google Spider (Googlebot), cómo rastrea e indexa sitios web y por qué es esencial para el SEO. Descubre cómo optimizar tu sitio para un mejor rastreo.

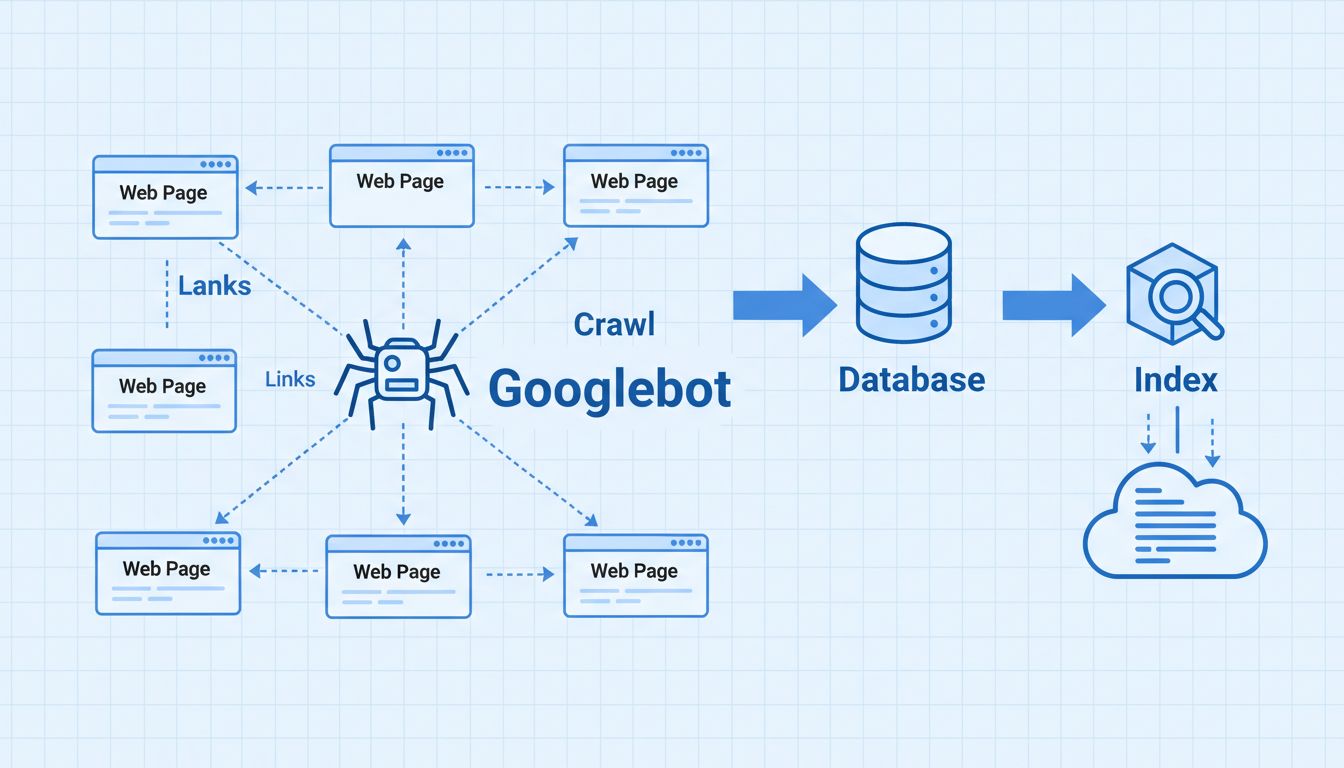

El Google Spider, formalmente conocido como Googlebot, es un programa automatizado que rastrea sitios web para descubrir, indexar y almacenar contenido en la base de datos de Google. Sigue enlaces para encontrar páginas nuevas o actualizadas, las cuales son procesadas y añadidas al índice de búsqueda de Google, permitiendo que el motor de búsqueda ofrezca resultados relevantes a los usuarios.

El Google Spider, conocido formalmente como Googlebot, es un programa de software automatizado que rastrea de manera sistemática Internet para descubrir, analizar e indexar contenido web. Es la herramienta principal que utiliza Google para explorar sitios web, recopilar información y construir su enorme índice de búsqueda. Sin Googlebot, Google no podría descubrir nuevas páginas, detectar actualizaciones de contenido existente ni proporcionar resultados de búsqueda relevantes a miles de millones de usuarios en todo el mundo. El spider opera de manera continua, visitando millones de sitios web cada día para asegurar que el índice de Google se mantenga actualizado y completo.

Googlebot es esencialmente un rastreador web sofisticado que sigue un proceso algorítmico complejo para determinar qué sitios visitar, con qué frecuencia rastrearlos y cuántas páginas obtener de cada dominio. El rastreador lee el código HTML, el contenido de texto y los metadatos de cada página que visita, luego almacena esta información en la base de datos central de Google. Este proceso de indexación es fundamental para el funcionamiento de los motores de búsqueda y afecta directamente la visibilidad de tu sitio web en los resultados de búsqueda.

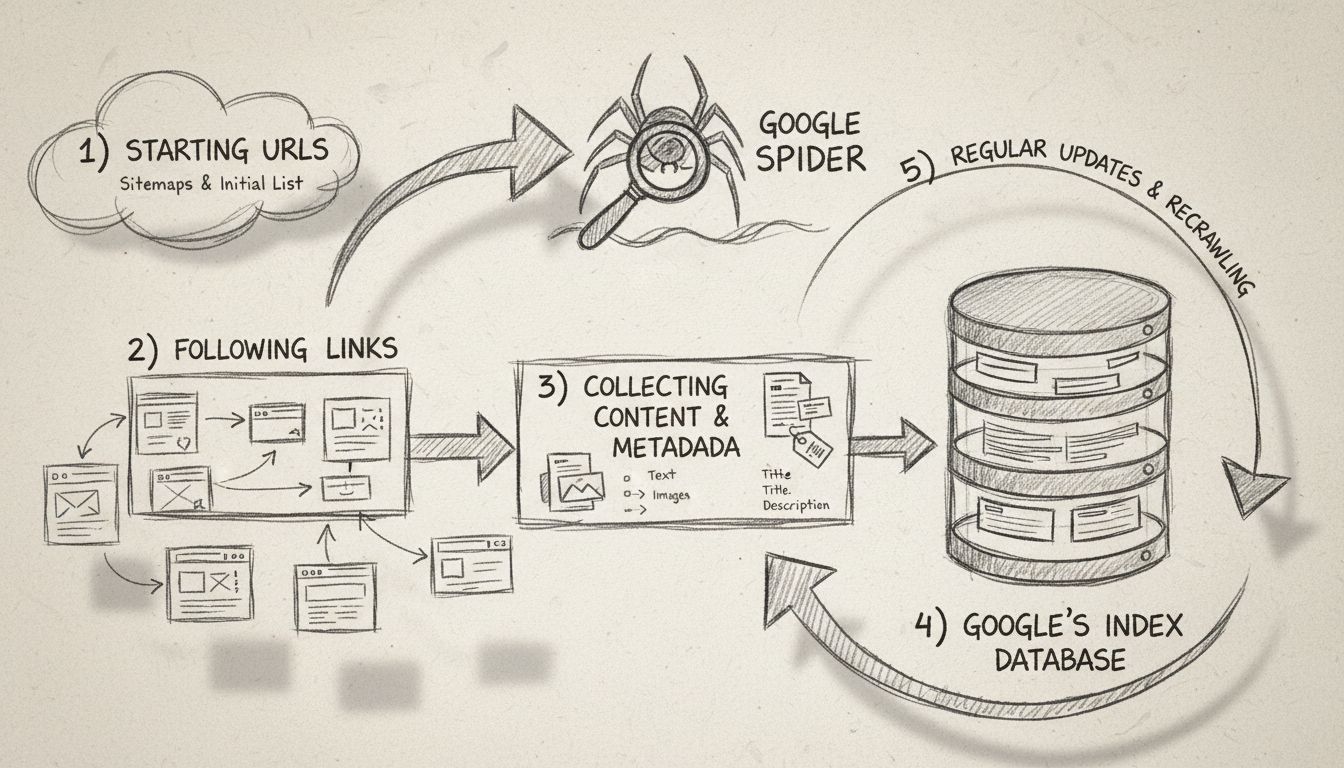

El Google Spider opera a través de un proceso de rastreo bien definido que comienza con una lista inicial de páginas web conocidas. Esta lista se genera a partir de procesos de rastreo previos y se complementa continuamente con los datos del sitemap proporcionados por los webmasters a través de Google Search Console. Cuando Googlebot visita un sitio web, no solo lee el contenido, sino que realiza un análisis exhaustivo de la estructura de la página, sigue enlaces internos y externos, e identifica cualquier cambio o contenido nuevo que se haya podido añadir desde la última visita.

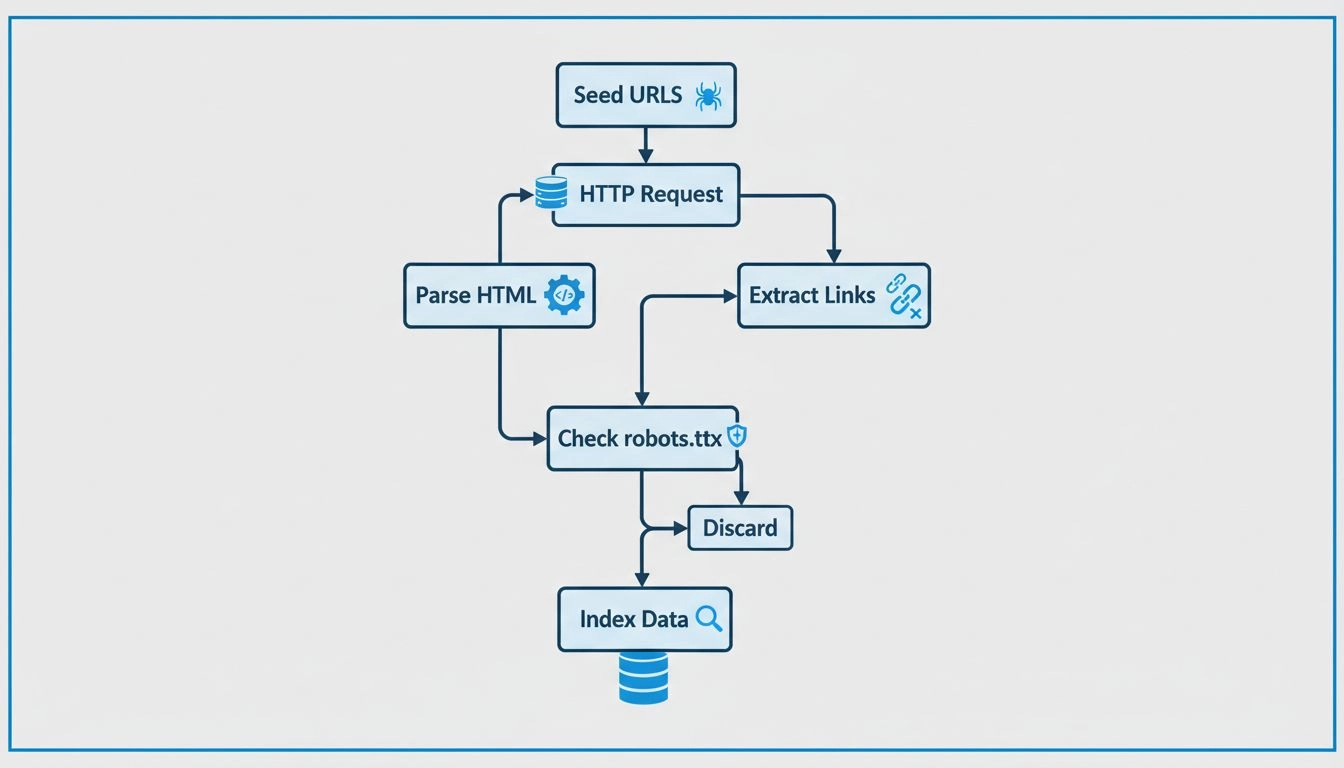

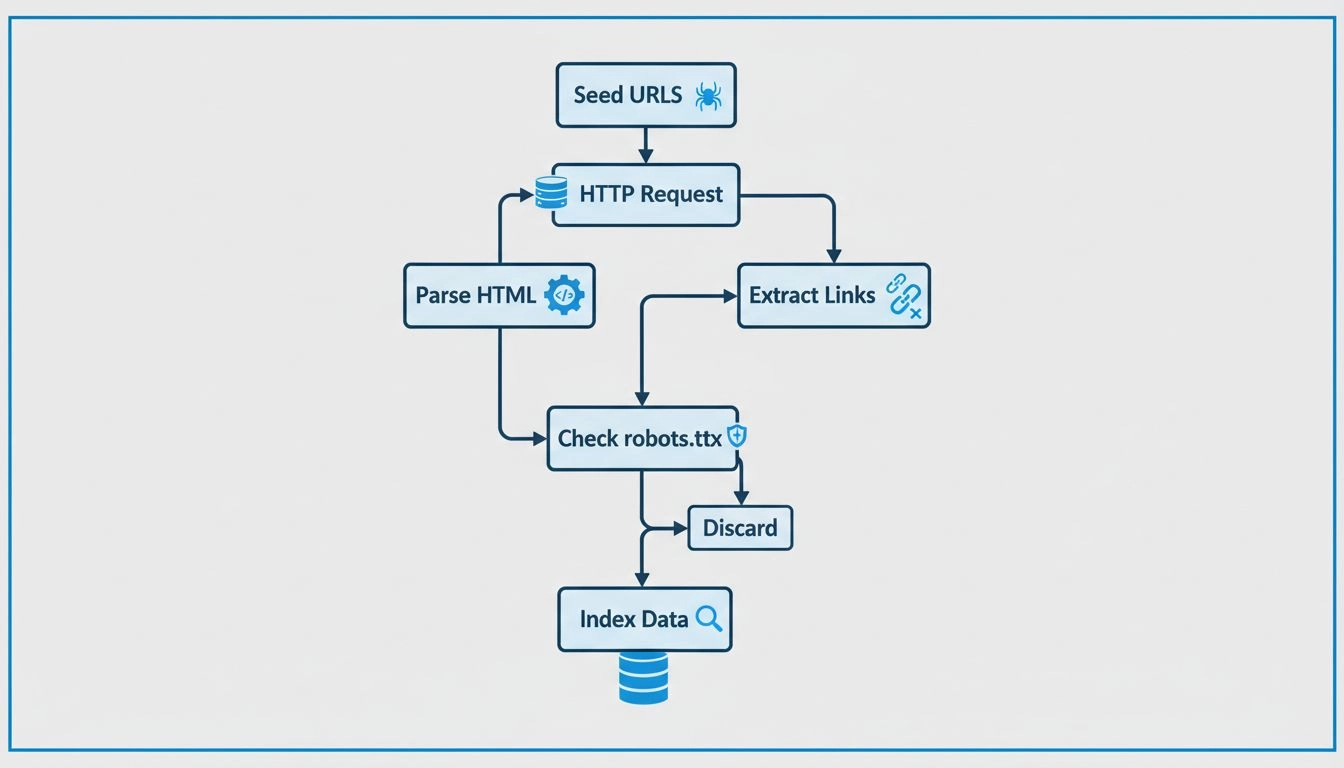

El proceso de rastreo sigue estos pasos clave: Primero, Googlebot comienza con una lista de URLs de páginas web obtenidas de rastreos y sitemaps anteriores. Segundo, navega por los sitios web siguiendo enlaces (tanto atributos SRC como HREF) en cada página para descubrir contenido nuevo. Tercero, el rastreador obtiene y analiza el contenido de cada página, incluyendo texto, estructura HTML, metadatos y otra información relevante. Cuarto, estos datos recopilados se envían a los servidores de Google para su procesamiento y almacenamiento en el índice de búsqueda. Finalmente, Googlebot vuelve a visitar los sitios web a intervalos regulares para comprobar si hay contenido nuevo, actualizaciones o cambios en las páginas existentes.

Google opera múltiples variantes especializadas de rastreadores, cada una diseñada para fines específicos e identificada por cadenas de agente de usuario únicas. Comprender estos diferentes tipos ayuda a los propietarios de sitios web a optimizar sus sitios para el rastreador adecuado. Las principales variantes de Googlebot incluyen el rastreador de escritorio, el rastreador móvil, el rastreador de video, el rastreador de imágenes y el rastreador de noticias, cada uno con funciones distintas dentro del ecosistema de indexación de Google.

| Tipo de Googlebot | Cadena User-Agent | Propósito |

|---|---|---|

| Googlebot (Escritorio) | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Rastrea versiones de escritorio de sitios web para el índice de búsqueda general |

| Googlebot (Móvil) | Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Rastrea versiones optimizadas para móviles de sitios web |

| Googlebot-Video | Googlebot-Video/1.0 | Indexa contenido de video incrustado en páginas web |

| Googlebot-Image | Googlebot-Image/1.0 | Rastrea e indexa imágenes para la búsqueda de Google Imágenes |

| Googlebot-News | Googlebot-News | Rastrea contenido de noticias para la agregación de Google News |

Además de estos rastreadores principales, Google también opera bots especializados para otros propósitos. AdSense Bot revisa la calidad y el cumplimiento de los anuncios, mientras que el rastreador de aplicaciones móviles para Android indexa contenido de aplicaciones Android. Cada bot tiene un identificador de agente de usuario distintivo que permite a los administradores de sitios web rastrear qué rastreador específico está accediendo a su sitio a través de los registros del servidor. Esta distinción es importante porque los distintos rastreadores pueden tener diferentes presupuestos y prioridades de rastreo, lo que afecta la frecuencia con la que visitan tu sitio.

El Google Spider es absolutamente crucial para la optimización en motores de búsqueda porque determina si el contenido de tu sitio web es descubierto, indexado y posicionado en los resultados de búsqueda. Si Googlebot no puede rastrear tu sitio de manera efectiva, tus páginas no aparecerán en el índice de Google, haciéndolas invisibles para los posibles visitantes que buscan tus productos o servicios. Por eso el SEO técnico—asegurar que tu sitio sea apto para rastreadores—es uno de los pilares más importantes de cualquier estrategia SEO exitosa.

Cuando Googlebot rastrea tu sitio web, compila un índice masivo de todas las palabras que encuentra y su ubicación en cada página, junto con información HTML como etiquetas de título, meta descripciones y estructuras de encabezado. Esta información indexada se almacena en la base de datos de Google y es utilizada por los algoritmos de búsqueda para clasificar páginas y determinar cuán valioso es tu contenido para consultas de búsqueda específicas. Cuanto más eficientemente pueda rastrear Googlebot tu sitio, más frecuentemente volverá y más rápido se indexará y posicionará contenido nuevo en los resultados de búsqueda.

Para asegurarte de que Googlebot pueda rastrear tu sitio web de forma efectiva y eficiente, debes implementar varias buenas prácticas técnicas. Primero, mantén una estructura de sitio clara y lógica con una navegación adecuada que facilite al rastreador descubrir todas las páginas importantes. El enlazado interno debe ser estratégico y relevante, utilizando textos ancla descriptivos que ayuden tanto a los usuarios como a los rastreadores a entender el contexto de las páginas enlazadas. Tu sitio web debe cargar rápidamente, ya que la velocidad de carga es un factor que influye en la eficiencia del rastreo y en cuántas páginas podrá rastrear Googlebot dentro de su presupuesto asignado.

Crea y envía un sitemap XML a Google Search Console, lo que proporciona a Googlebot una lista completa de todas las páginas que deseas que sean indexadas. Esto es especialmente importante para sitios web grandes o con páginas que no sean fácilmente descubribles mediante enlaces internos. Además, asegúrate de que tu archivo robots.txt esté configurado correctamente para permitir que Googlebot acceda a las páginas que quieres indexar, bloqueando el acceso a áreas sensibles o contenido duplicado. Sin embargo, ten cuidado de no bloquear accidentalmente páginas importantes, ya que esto impedirá por completo su indexación.

Google Search Console es una herramienta esencial para monitorear cómo interactúa Googlebot con tu sitio web e identificar posibles problemas de rastreo que puedan impedir una indexación adecuada. La sección de Estadísticas de rastreo proporciona información detallada sobre cuántas páginas rastreó Googlebot, cuánto tiempo pasó rastreando tu sitio y cuántos errores encontró. Puedes ver el tiempo de respuesta promedio de tu servidor, lo que impacta directamente en la eficiencia con la que Googlebot puede rastrear tus páginas—servidores lentos significan menos páginas rastreadas en el mismo período de tiempo.

El informe de Cobertura en Google Search Console muestra qué páginas han sido indexadas correctamente, cuáles presentan errores que impiden su indexación y cuáles están excluidas del índice. Esta información es invaluable para identificar problemas técnicos como enlaces rotos, errores de servidor o páginas bloqueadas por robots.txt que quizás no pretendías bloquear. También puedes utilizar la herramienta de Inspección de URL para probar cómo ve Googlebot una página específica, incluso si puede renderizar contenido JavaScript y acceder a todos los recursos necesarios para mostrar la página correctamente.

Cada sitio web posee un “presupuesto de rastreo”—el número de páginas que Googlebot rastreará en tu sitio en un periodo determinado. Para la mayoría de los sitios web, el presupuesto de rastreo no es un factor limitante, pero para sitios muy grandes con miles o millones de páginas, optimizar el presupuesto de rastreo se vuelve importante. Google asigna el presupuesto de rastreo en función de dos factores: la capacidad de rastreo (cuánto puede soportar tu servidor) y la demanda de rastreo (qué tan importante considera Google tu sitio). Mejorar la velocidad de tu sitio y corregir errores de rastreo aumenta la capacidad de rastreo, mientras que crear contenido de alta calidad y actualizado frecuentemente incrementa la demanda de rastreo.

Para optimizar tu presupuesto de rastreo, elimina contenido duplicado que malgasta recursos de rastreo, corrige enlaces rotos y cadenas de redirecciones, y elimina páginas que no aportan valor a los usuarios. Evita bloquear páginas importantes con robots.txt o etiquetas noindex y asegúrate de que la estructura de tu sitio facilite a Googlebot descubrir todas las páginas importantes en pocos clics desde la página de inicio. Actualizar regularmente tu sitemap XML y eliminar páginas obsoletas ayuda a que Googlebot centre sus esfuerzos de rastreo en el contenido que más importa para tu negocio.

Los propietarios de sitios web suelen encontrarse con diversos problemas que impiden que Googlebot rastree sus sitios de manera efectiva. Los errores de servidor (códigos de estado 5xx) indican que tu servidor tiene problemas para responder a las solicitudes, lo que puede impedir la indexación de páginas. Las cadenas de redirecciones—donde una página redirige a otra, que a su vez redirige a una tercera—malgastan presupuesto de rastreo y ralentizan el proceso de indexación. Los recursos bloqueados, como archivos CSS o JavaScript bloqueados por robots.txt, pueden impedir que Googlebot renderice y comprenda correctamente tus páginas.

Los errores Soft 404 ocurren cuando una página devuelve un código de estado 200 (éxito) pero contiene poco o ningún contenido real, lo que confunde a Googlebot sobre si la página debe ser indexada. Las etiquetas noindex aplicadas accidentalmente a páginas importantes impiden que aparezcan en los resultados de búsqueda. Los tiempos de carga lentos reducen la cantidad de páginas que Googlebot puede rastrear dentro de su presupuesto asignado. Para abordar estos problemas, audita regularmente tu sitio web con Google Search Console, monitorea los registros de servidor en busca de errores de rastreo y utiliza herramientas como Screaming Frog para identificar problemas técnicos antes de que afecten tu visibilidad en las búsquedas.

En 2025, el Google Spider sigue siendo tan importante como siempre, aunque su función ha evolucionado para adaptarse a nuevas tecnologías y formatos de contenido. Googlebot ahora maneja la renderización de JavaScript, lo que significa que puede rastrear e indexar contenido generado dinámicamente por frameworks JavaScript. También procesa el marcado de datos estructurados (Schema.org) para comprender mejor el contenido de las páginas y ofrecer fragmentos enriquecidos en los resultados de búsqueda. La indexación orientada a móviles significa que Googlebot prioriza el rastreo y la indexación de la versión móvil de tu sitio web, haciendo que la optimización móvil sea esencial para el éxito en el SEO.

El spider también juega un papel crucial en la capacidad de Google para detectar y combatir el spam, identificar contenido hackeado y asegurar que los resultados de búsqueda sigan siendo relevantes y confiables. A medida que los motores de búsqueda siguen evolucionando con tecnologías de IA y aprendizaje automático, las capacidades de rastreo e indexación de Googlebot se vuelven aún más sofisticadas, permitiendo a Google comprender mejor la intención del usuario y ofrecer resultados de búsqueda más precisos. Entender cómo funciona Googlebot y optimizar tu sitio web en consecuencia sigue siendo uno de los aspectos más fundamentales de una estrategia SEO exitosa.

Así como Google Spider rastrea e indexa tu contenido, PostAffiliatePro te ayuda a monitorear y optimizar el rendimiento de tu marketing de afiliados. Supervisa cada clic, conversión y comisión con nuestra plataforma líder en gestión de afiliados.

Aprende cómo funcionan los rastreadores web, desde las URLs semilla hasta la indexación. Comprende el proceso técnico, los tipos de rastreadores, las reglas de ...

Los rastreadores acumulan datos e información de internet visitando sitios web y leyendo las páginas. Descubre más sobre ellos.

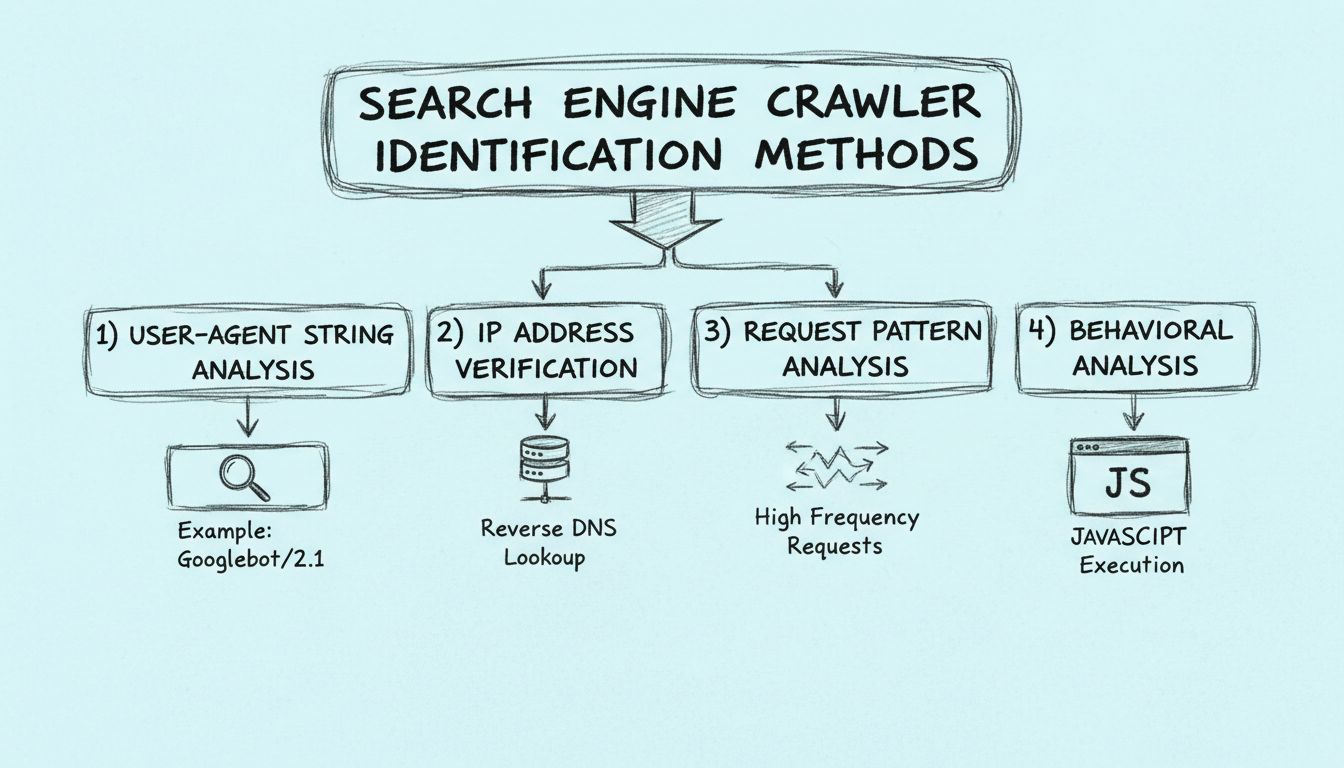

Aprende cómo identificar rastreadores de motores de búsqueda mediante cadenas de user-agent, direcciones IP, patrones de solicitud y análisis de comportamiento....

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.