Rastreadores y su papel en el posicionamiento en buscadores

Los rastreadores acumulan datos e información de internet visitando sitios web y leyendo las páginas. Descubre más sobre ellos.

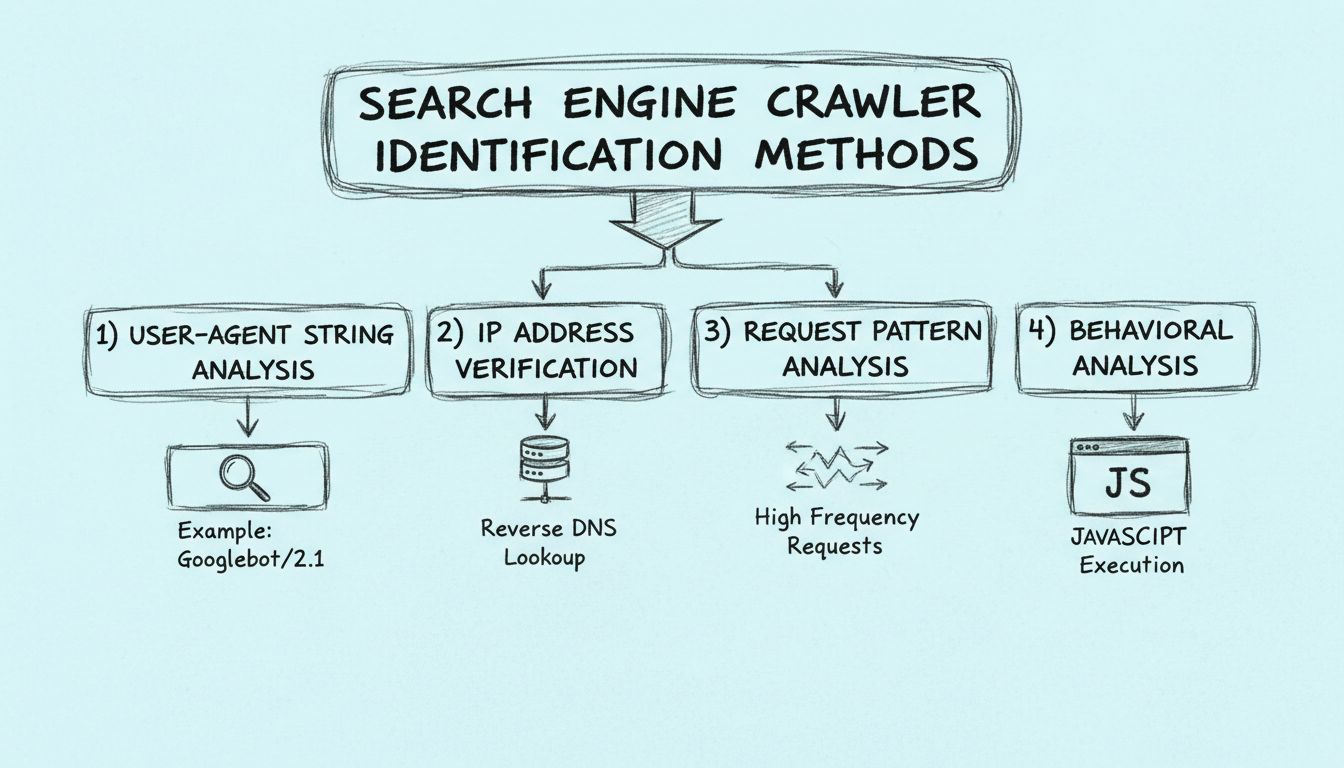

Aprende cómo identificar rastreadores de motores de búsqueda mediante cadenas de user-agent, direcciones IP, patrones de solicitud y análisis de comportamiento. Guía esencial para webmasters y desarrolladores.

Los rastreadores de motores de búsqueda se pueden identificar mediante cuatro métodos principales: analizando la cadena user-agent en los encabezados HTTP, verificando la dirección IP de origen y el nombre de host DNS inverso, monitoreando los patrones de solicitud para detectar accesos de alta frecuencia y examinando características de comportamiento como la capacidad de ejecutar JavaScript.

Los rastreadores de motores de búsqueda son programas automatizados que navegan sistemáticamente por internet para descubrir, analizar e indexar contenido web. Identificar estos rastreadores es crucial para webmasters, desarrolladores y marketers de afiliados que necesitan comprender los patrones de tráfico de su sitio web y garantizar el acceso legítimo de los motores de búsqueda. A diferencia de los bots maliciosos que intentan extraer datos o lanzar ataques, los rastreadores legítimos como Googlebot, Bingbot y otros se identifican a través de marcadores técnicos específicos que pueden verificarse y autenticarse.

La capacidad de distinguir entre rastreadores de motores de búsqueda legítimos y otros tipos de bots se ha vuelto cada vez más importante en 2025 a medida que el tráfico web continúa creciendo y la actividad de bots se vuelve más sofisticada. Comprender los métodos de identificación te ayuda a optimizar la capacidad de rastreo de tu sitio, proteger tus recursos de accesos no autorizados y asegurar que tus sistemas de seguimiento de afiliados distingan con precisión entre tráfico orgánico de búsqueda y otras fuentes. PostAffiliatePro ofrece capacidades avanzadas de análisis que te ayudan a monitorear y categorizar fuentes de tráfico con precisión, asegurando que tu programa de afiliados capture datos de rendimiento exactos.

El método más directo para identificar rastreadores de motores de búsqueda es examinar la cadena User-Agent en el encabezado de la solicitud HTTP. Cada solicitud HTTP incluye un encabezado User-Agent que identifica al cliente que realiza la petición, ya sea un navegador web, una aplicación móvil o un rastreador. Los rastreadores legítimos incluyen identificadores distintivos en sus cadenas User-Agent que indican claramente su origen y propósito. Por ejemplo, el rastreador de Google se identifica como “Googlebot/2.1 (+http://www.google.com/bot.html)”, mientras que el rastreador de Bing de Microsoft utiliza “Bingbot/2.0 (+http://www.bing.com/bingbot.htm)”.

Al analizar las cadenas User-Agent, debes buscar patrones y palabras clave específicas que indiquen rastreadores de motores de búsqueda legítimos. La cadena User-Agent suele contener el nombre del rastreador, el número de versión y un enlace a la documentación o página informativa del rastreador. Los rastreadores legítimos de los principales motores de búsqueda como Google, Bing, Yahoo y Yandex siguen convenciones de nomenclatura consistentes e incluyen información verificable sobre su propósito. Puedes registrar estas cadenas User-Agent en los registros de acceso de tu servidor y compararlas con los identificadores de rastreadores conocidos mantenidos por los motores de búsqueda y organizaciones de seguridad.

| Nombre del rastreador | Ejemplo de cadena User-Agent | Motor de búsqueda |

|---|---|---|

| Googlebot | Googlebot/2.1 (+http://www.google.com/bot.html) | |

| Bingbot | Bingbot/2.0 (+http://www.bing.com/bingbot.htm) | Microsoft Bing |

| Slurp | Slurp/cat (+http://help.yahoo.com/help/us/ysearch/slurp) | Yahoo |

| Yandexbot | Mozilla/5.0 (compatible; YandexBot/3.0) | Yandex |

| DuckDuckBot | DuckDuckBot/1.0 (+http://duckduckgo.com/duckduckbot.html) | DuckDuckGo |

Sin embargo, depender únicamente de las cadenas User-Agent para la identificación de rastreadores tiene limitaciones. Los bots maliciosos pueden suplantar cadenas User-Agent para hacerse pasar por rastreadores legítimos, por lo que es esencial combinar este método con técnicas adicionales de verificación. Además, algunos rastreadores legítimos pueden usar cadenas User-Agent genéricas o modificadas en ciertas situaciones, por lo que comparar con otros métodos de identificación proporciona resultados más confiables.

El segundo método clave para identificar rastreadores de motores de búsqueda implica verificar la dirección IP de origen y realizar una búsqueda DNS inversa. Cuando un rastreador realiza una solicitud a tu servidor, proviene de una dirección IP específica que puede registrarse y analizarse. Los motores de búsqueda publican los rangos de direcciones IP que usan sus rastreadores, lo que permite a los webmasters verificar si una solicitud proviene realmente de la infraestructura de ese motor de búsqueda. Google, por ejemplo, mantiene una lista completa de direcciones IP utilizadas por Googlebot y otros rastreadores de Google.

La búsqueda DNS inversa es una técnica de verificación especialmente eficaz que consiste en consultar el sistema DNS para determinar el nombre de host asociado a una dirección IP. Cuando realizas una búsqueda DNS inversa sobre una IP que afirma ser de Google, debería resolverse en un nombre de host dentro del dominio de Google (como “crawl-66-249-64-1.googlebot.com”). Este nombre de host puede verificarse posteriormente mediante una búsqueda DNS directa para confirmar que el nombre de host resuelve a la misma dirección IP, creando una cadena de verificación bidireccional. Este proceso de verificación hace extremadamente difícil que actores maliciosos suplanten la identidad de un rastreador, ya que necesitarían controlar tanto la dirección IP como los registros DNS asociados.

La documentación oficial de Google recomienda este método de verificación como la forma más confiable de confirmar solicitudes de Googlebot. El proceso consiste en comprobar que el nombre de host DNS inverso coincida con el patrón de dominio de Google y luego verificar que una búsqueda DNS directa de ese nombre de host devuelva la misma dirección IP. Este método es especialmente valioso para sitios web de alto tráfico y redes de afiliación que necesitan asegurar una atribución precisa del tráfico y prevenir que la actividad de bots fraudulentos se cuente como tráfico legítimo de motores de búsqueda.

El análisis de patrones de solicitud proporciona información valiosa sobre el comportamiento de los rastreadores al examinar cómo se distribuyen las solicitudes a lo largo del tiempo y a través de los recursos de tu sitio web. Los rastreadores legítimos siguen patrones predecibles que difieren significativamente del comportamiento de navegación humana o de la actividad de bots maliciosos. Los rastreadores suelen realizar solicitudes en intervalos consistentes, siguen un patrón lógico de recorrido a través de la estructura de URLs de tu sitio y respetan las directivas especificadas en tu archivo robots.txt. Al monitorear estos patrones, puedes identificar rastreadores legítimos y diferenciarlos de actividades sospechosas.

Al analizar los patrones de solicitud, busca varias características clave que indiquen comportamiento legítimo de rastreadores. Primero, examina la frecuencia y distribución de las solicitudes: los rastreadores legítimos suelen espaciar sus solicitudes para evitar sobrecargar tu servidor, a menudo siguiendo algoritmos de “exponential backoff” que ralentizan si reciben errores HTTP 500 u otros indicadores de presión en el servidor. Segundo, analiza el patrón de recorrido de URLs: los rastreadores legítimos siguen enlaces sistemáticamente y respetan la estructura del sitio, mientras que los bots maliciosos suelen realizar solicitudes aleatorias o secuenciales a URLs que no existen o que no están enlazadas desde tu sitio. Tercero, monitorea los tipos de recursos solicitados: los rastreadores legítimos suelen solicitar páginas HTML, archivos CSS y JavaScript necesarios para renderizar las páginas, evitando solicitudes innecesarias a archivos binarios o directorios sensibles.

Puedes implementar el monitoreo de patrones de solicitud analizando los registros de tu servidor e identificando conjuntos de solicitudes que compartan características comunes. Herramientas como plataformas de análisis web y software de análisis de registros de servidor pueden ayudar a automatizar este proceso señalando patrones inusuales. Por ejemplo, si una sola dirección IP realiza 1,000 solicitudes por minuto a distintas páginas de productos en un patrón secuencial, es probable que sea un rastreador. En cambio, los rastreadores legítimos de motores de búsqueda suelen realizar solicitudes a una frecuencia mucho menor, espaciando las peticiones varios segundos para respetar los recursos del servidor y evitar activar mecanismos de limitación de velocidad.

El análisis de comportamiento examina cómo los rastreadores interactúan con el contenido y la tecnología de tu sitio web, proporcionando información que permite distinguir rastreadores legítimos de otros tipos de bots. Una de las características de comportamiento más importantes es la capacidad de ejecutar JavaScript. Los motores de búsqueda modernos como Google renderizan páginas usando un navegador sin interfaz (similar a Chrome) para ejecutar JavaScript y acceder a contenido generado dinámicamente. Esto significa que los rastreadores legítimos ejecutarán código JavaScript en tus páginas, mientras que muchos bots maliciosos o scrapers simples no pueden o no ejecutan JavaScript.

Puedes detectar la ejecución de JavaScript insertando código de seguimiento que solo se active cuando JavaScript esté habilitado y funcionando. Si una solicitud accede a tu página pero no activa el seguimiento dependiente de JavaScript o no carga contenido generado dinámicamente, indica que el solicitante podría no ser un rastreador moderno de motores de búsqueda. Además, los rastreadores legítimos suelen cargar todos los recursos necesarios para renderizar completamente una página, incluyendo imágenes, hojas de estilo y archivos JavaScript, mientras que los bots simples pueden solicitar solo el archivo HTML sin cargar los recursos de soporte.

Otro indicador de comportamiento importante es cómo los rastreadores gestionan elementos interactivos y envíos de formularios. Los rastreadores legítimos de motores de búsqueda no envían formularios, no hacen clic en botones ni interactúan con contenido dinámico de formas que puedan causar efectos secundarios no deseados como realizar pedidos o modificar datos. Se centran en leer y analizar el contenido en lugar de interactuar con él. Los bots maliciosos, en cambio, a menudo intentan interactuar con formularios, enviar datos o activar acciones que puedan dañar tu sitio web o robar información. Al monitorear estos patrones de comportamiento, puedes identificar solicitudes que intentan interacciones no autorizadas y diferenciarlas de la actividad legítima de rastreadores.

El enfoque más eficaz para la identificación de rastreadores combina los cuatro métodos en un flujo de verificación integral. En lugar de depender de un solo método, implementar un sistema de verificación en capas brinda una protección robusta contra rastreadores suplantados y asegura una atribución precisa del tráfico. Comienza capturando la cadena User-Agent y la dirección IP de cada solicitud, luego contrasta estos datos con bases de rastreadores conocidos mantenidas por motores de búsqueda y organizaciones de seguridad. A continuación, realiza una búsqueda DNS inversa para verificar que el nombre de host de la dirección IP coincida con el dominio del motor de búsqueda alegado. Finalmente, analiza el patrón de solicitudes y las características de comportamiento para asegurar que la actividad se alinee con el comportamiento de un rastreador legítimo.

Este enfoque en múltiples capas es especialmente importante para redes de afiliados y plataformas de marketing de desempeño como PostAffiliatePro, donde la atribución precisa del tráfico impacta directamente en los cálculos de comisiones y la integridad del programa. Al implementar una identificación de rastreadores integral, puedes asegurar que tus sistemas de seguimiento de afiliados distingan con precisión entre tráfico legítimo de motores de búsqueda, tráfico de publicidad pagada y tráfico orgánico de usuarios. Esta precisión permite un mejor análisis de desempeño, cálculos de ROI más exactos y capacidades mejoradas de detección de fraudes.

La infraestructura web moderna requiere sistemas sofisticados de identificación de rastreadores que puedan manejar la complejidad del tráfico web contemporáneo. Primero, mantén una lista actualizada de direcciones IP y cadenas User-Agent de rastreadores legítimos suscribiéndote a notificaciones oficiales de los principales motores de búsqueda. Google, Bing y otros motores publican actualizaciones cuando agregan nuevos rastreadores o cambian su infraestructura, y mantenerse informado sobre estos cambios asegura que tus sistemas de identificación sigan siendo actuales. Segundo, implementa el registro del lado del servidor para capturar todos los metadatos relevantes de las solicitudes, incluidas cadenas User-Agent, direcciones IP, marcas de tiempo y recursos solicitados. Estos datos proporcionan la base para el análisis de patrones y el monitoreo de comportamiento.

Tercero, considera implementar una API o servicio de verificación de rastreadores que valide automáticamente la identidad de los rastreadores en tiempo real. Muchas plataformas de seguridad y análisis ahora ofrecen servicios de identificación de rastreadores que mantienen bases de datos actualizadas de rastreadores legítimos y pueden verificar solicitudes contra estas bases. Cuarto, establece políticas claras para manejar actividad de rastreadores no identificados o sospechosos. Puedes optar por servir estas solicitudes normalmente mientras las registras para su análisis, o implementar limitaciones de velocidad para prevenir el agotamiento de recursos. Finalmente, revisa y actualiza regularmente tus reglas y umbrales de identificación de rastreadores en función de los patrones de tráfico observados y amenazas emergentes. El panorama del rastreo web sigue evolucionando, y tus sistemas de identificación deben adaptarse en consecuencia para mantener su eficacia.

Identificar rastreadores de motores de búsqueda requiere una comprensión integral de varios métodos de verificación y la capacidad de combinarlos en un sistema de detección efectivo. Analizando las cadenas User-Agent, verificando direcciones IP mediante búsquedas DNS inversas, monitoreando patrones de solicitud y examinando características de comportamiento, puedes distinguir de manera confiable a los rastreadores legítimos de motores de búsqueda de otros tipos de bots y fuentes de tráfico. Esta capacidad es esencial para webmasters, desarrolladores y marketers de afiliados que necesitan comprender sus fuentes de tráfico y asegurar un seguimiento de rendimiento preciso. Las avanzadas capacidades de análisis y monitoreo de tráfico de PostAffiliatePro te ayudan a implementar estos métodos de identificación de manera efectiva, asegurando que tu programa de afiliados capture datos precisos y mantenga la integridad del programa en un panorama digital cada vez más complejo.

PostAffiliatePro es el software líder en gestión de afiliados que te ayuda a rastrear, gestionar y optimizar tu red de afiliados con precisión. Identifica fuentes de tráfico legítimas y maximiza el rendimiento de tu programa de afiliados con análisis avanzados y monitorización en tiempo real.

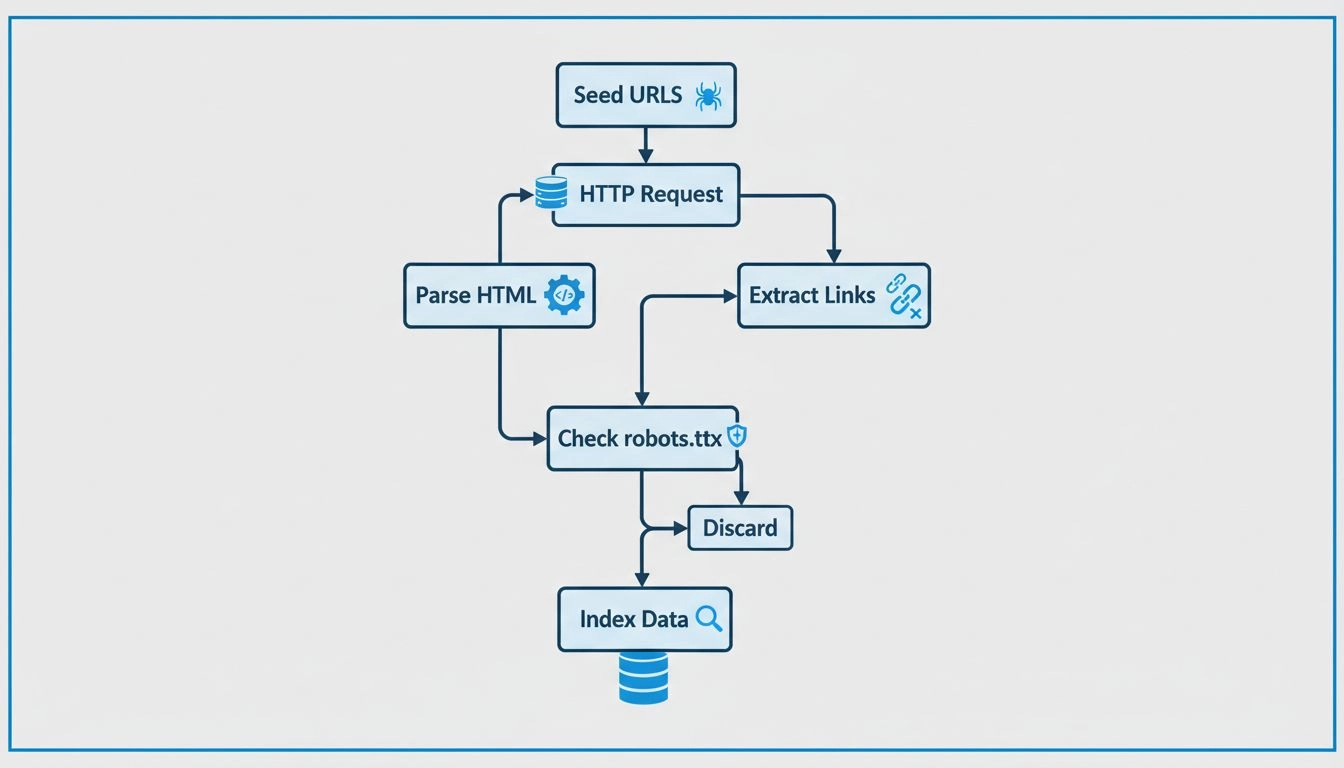

Los rastreadores acumulan datos e información de internet visitando sitios web y leyendo las páginas. Descubre más sobre ellos.

Aprende cómo funcionan los rastreadores web, desde las URLs semilla hasta la indexación. Comprende el proceso técnico, los tipos de rastreadores, las reglas de ...

Descubre por qué los sitemaps son cruciales para el éxito en SEO. Aprende cómo los sitemaps XML y HTML mejoran la rastreabilidad, la indexación y la visibilidad...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.